詳細情報:

サードパーティ監視ツールへのログストリーミングの設定

エンタープライズ規模の監視と自動化のために、Splunk、Datadog、Grafana Loki、New Relic、Dynatrace、SumoLogic、AWS Elastic Cloudなどのサードパーティ分析プラットフォームにログをストリーミングします。また、汎用 HTTP 接続を使用して、ログを他のツールにストリーミングすることもできます。

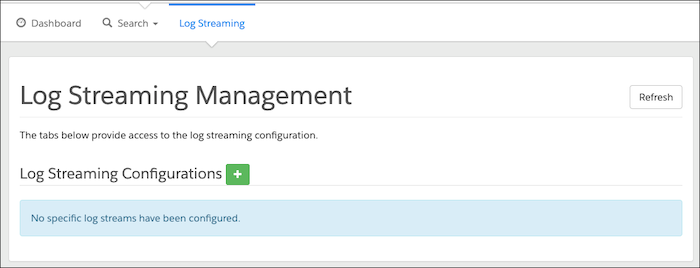

- Log Center にログインします。

-

Log Streaming (ログストリーミング) タブを選択します。

-

Log Streaming Configurations (ログ・ストリーミング構成) のプラスアイコンをクリックして、新しいログストリーム構成を作成します。

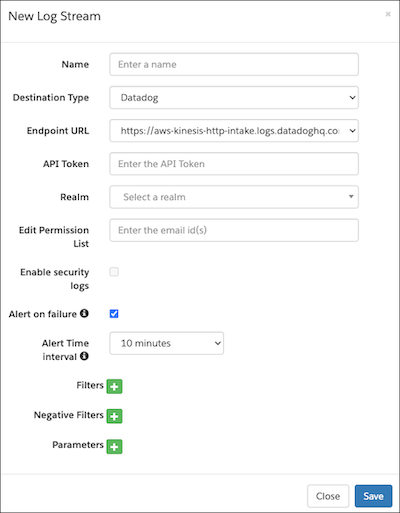

- ログストリーム名を入力します。英数字とスペースを含む特殊文字を使用できます。複数の構成に同じ名前を使用することはできません。

- 「Destination Type (宛先タイプ)」ドロップダウンから、宛先タイプを選択します。オプションには、Splunk (Cloud と Enterprise をサポート)、Datadog、New Relic、Grafana Loki、Dynatrace、SumoLogic、AWS Elastic Cloud、汎用 HTTP が含まれます。

-

ログの宛先として、サードパーティのエンドポイント URL を入力します。

宛先タイプ エンドポイント URL Splunk Splunk Cloud: https://http-inputs-firehose-<your_unique_cloud_hostname>.splunkcloud.com

Splunk Enterprise: Splunk Add-on for Amazon Kinesis Firehose (Amazon Kinesis Firehose 用 Splunk アドオン) を参照してください。

Datadog US1: https://aws-kinesis-http-intake.logs.datadoghq.com/v1/input

US3: https://aws-kinesis-http-intake.logs.us3.datadoghq.com/api/v2/logs?dd-protocol=aws-kinesis-firehose

US5: https://aws-kinesis-http-intake.logs.us5.datadoghq.com/api/v2/logs?dd-protocol=aws-kinesis-firehose

AP1: https://aws-kinesis-http-intake.logs.ap1.datadoghq.com/api/v2/logs?dd-protocol=aws-kinesis-firehose

EU: https://aws-kinesis-http-intake.logs.datadoghq.eu/v1/input

New Relic Grafana Loki https://aws-logs-prod.grafana.net/aws-logs/api/v1/push Dynatrace https://live.dynatrace.com/api/v2/logs/ingest/aws_firehose SumoLogic AWS Elastic Cloud https://es.aws.elastic-cloud.com 汎用 HTTP 仕様に従い、Firehose からの配信を受信できる任意の HTTPS エンドポイント。 - ユーザー ID を入力します (Grafana Loki の場合は必須)。

-

サードパーティツールの API トークンを入力します。

宛先タイプ API トークン 参照ドキュメント Splunk 認証トークン Splunk Add-on for Amazon Kinesis Firehose (Amazon Kinesis Firehose 用 Splunk アドオン) Datadog 認証キー Datadog API キーとアプリケーションキー New Relic API キー New Relic APIキー Grafana Loki トークン Grafana Labs:Configure Logs with Firehose (Firehose を使用したログの構成) Dynatrace API トークン Stream logs via Amazon Data Firehose (Amazon Data Firehose によるログのストリーミング) SumoLogic 任意 Sumo Logic: AWS Kinesis Firehose for Logs Source (ログ用 AWS Kinesis Firehose ソース) AWS Elastic Cloud API キー Elastic: Monitor Amazon Web Services (AWS) with Amazon Data Firehose (Amazon Data Firehose を使用した Amazon Web Services (AWS) の監視) 汎用 HTTP カスタマイズされた認証 該当なし。 -

ドロップダウンメニューからレルムを選択し、ストリームの数を構成します。

各レルムでは、宛先タイプごとに最大 5 つのストリームを構成できます。

-

(オプション) 許可リストを編集します。次のガイドラインに注意してください。

- ログストリームを構成したユーザーが、主要所有者 (Primary Owner) になります。

- 主要所有者は、同じレルムに割り当てられた他のユーザーの許可を有効化、編集、削除できます。

- メール ID をコンマ区切りで入力してユーザーを指定します。メール ID の数に制限はありません。

- 無効または正しくないメールアドレスは無視されます。

- 同じレルムに割り当てられたユーザーは、レルムを表示できますが、編集や削除の許可はありません。

-

(オプション) フィルターを設定します。プラス記号をクリックします。

表に示されているとおりに、フィルターフィールドの値を正確に入力してください。正確でない場合、値は無視されます。

- 1 つのフィルターのタイプに複数の値がある場合は、OR 演算子を使用します

- フィルターのタイプが複数ある場合は、AND 演算子を使用します

- 同じタイプに対して、フィルターとネガティブフィルターを同時に構成することはできません。

- 各行は 1 つのフィルタータイプを表します。同じタイプの行を複数構成すると、それらは結合されます

タイプ 説明 例 Category (カテゴリ) 検索集計のログカテゴリタイプ。値はコンマ区切りで入力します。 - カテゴリタイプ

- system

- custom

- customfiles

- Jdbc

- syslog

- api

- job

- staging

- sysevent

- analytics

- quota

- deprecation

- impex

- batch

- migration

Request (リクエスト) 検索集計のログリクエストタイプ。値はコンマ区切りで入力します。 - リクエストタイプ

- JOB

- BUSINESSMGR

- STOREFRONT

- TEMPORARY

- REST

Service (サービス) 検索集計のログサービスタイプ。値はコンマ区切りで入力します。 - サービスタイプ

- ecom

- JWA

- MRT

Severity (重大度) 検索集計のログ重大度。値はコンマ区切りで入力します。 - 重大度

- info

- warn

- error

- debug

- fatal

Tenant Name (テナント名) 検索集計のログテナント名 ID。値はコンマ区切りで入力します。 - テナント名

- production.functional09.qa222 bgzz_prd

- dev02.functional09.qa222 bgzz_s02

- dev04.functional09.qa222 bgzz_s04

Tenant Type (テナントタイプ) 検索集計のログテナントタイプ。値はコンマ区切りで入力します。 - テナントタイプ

- sbx

- prd

- stg

- dev

-

(オプション) ネガティブフィルターを設定します。プラス記号をクリックします。

- 1 つのフィルターのタイプに複数の値がある場合は、OR 演算子を使用します

- フィルターのタイプが複数ある場合は、OR 演算子を使用します

- 同じタイプに対して、フィルターとネガティブフィルターを同時に構成することはできません。

- 各行は 1 つのタイプのフィルターを表します。同じタイプの行を複数構成すると、それらは結合されます

-

(オプション) パラメーターを設定します。Parameters (パラメーター) のプラスアイコンをクリックします。

パラメーターを使用すると、追加の HTTP ヘッダーをカスタマイズできます。これは最終的に X-Amz-Firehose-Common-Attributes ヘッダーとして送信されます。詳細については、Amazon Data Firehouse request and response specifications (Amazon Data Firehouse のリクエストとレスポンスの仕様) を参照してください。

- Grafana Loki は、接頭辞が lbl_ の HTTP ヘッダーキーをタグとして解析します。

- Datadog は、HTTP ヘッダーキーをタグとして解析します。

- New Relic は、HTTPヘッダーキーを属性として解析します。

- Splunk と Dynatrace はパラメーターをサポートしていません。

- Sumo Logic は、フィルタリングのために _sourceCategory 属性と _sourceName 属性を受け付けます。

- AWS Elastic Cloud は、es_datastream_name、include_cw_extracted_fields などのパラメーターを受け付けます。詳細については、Monitor Amazon Web Services (AWS) with Amazon Data Firehose (Amazon Data Firehose を使用した Amazon Web Services (AWS) の監視) を参照してください。

- 重複するパラメーターは結合されません。

- 構成の変更を保存します。

- Close (閉じる) をクリックします。

- ログストリーミングを設定したら、Refresh (リフレッシュ) をクリックし、エラーメッセージがないか確認します。